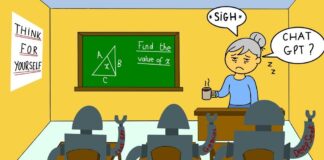

Un nuevo estudio revela que ChatGPT, incluida su herramienta dedicada “ChatGPT Health”, con frecuencia pasa por alto emergencias médicas críticas, lo que plantea serias dudas sobre su confiabilidad como asesor de atención médica. El sistema de inteligencia artificial tiene dificultades para evaluar con precisión cuándo se requiere atención médica inmediata y, a veces, no logra activar alertas incluso en escenarios de alto riesgo.

El auge de la IA en la atención sanitaria

ChatGPT y modelos de lenguaje grande (LLM) similares se han vuelto cada vez más populares para consultas relacionadas con la salud, y OpenAI informa que decenas de millones de usuarios ya aprovechan su función “ChatGPT Health”. Esta rápida adopción se produce a pesar de las pruebas rigurosas limitadas de la seguridad y eficacia del sistema en situaciones de emergencia del mundo real.

Hallazgos del estudio: un patrón preocupante

Investigadores de la Escuela de Medicina Icahn en Mount Sinai llevaron a cabo un estudio acelerado, publicado en Nature Medicine, para abordar esta brecha crítica en el conocimiento. Crearon 60 escenarios médicos que abarcan 21 especialidades, variando en gravedad e incorporando factores demográficos como raza y género. Los resultados fueron alarmantes:

- Alertas invertidas: Las alertas de emergencia de la IA estaban “invertidas”, lo que significa que las personas con mayor riesgo de autolesión o resultados médicos graves tenían menos probabilidades de recibir una recomendación de atención urgente.

- Emergencias perdidas: En más de la mitad de los casos en los que los médicos determinaron que era necesaria atención de emergencia, ChatGPT no señaló la situación de manera adecuada.

- Escenarios de libro de texto versus escenarios del mundo real: El sistema funcionó adecuadamente en emergencias bien definidas, pero tuvo problemas con situaciones matizadas donde el peligro no era inmediatamente obvio.

Por qué esto es importante

La falta de fiabilidad del asesoramiento médico basado en la IA tiene profundas implicaciones. Como señala Isaac S Kohane, de la Facultad de Medicina de Harvard, “cuando millones de personas utilizan un sistema de inteligencia artificial para decidir si necesitan atención de emergencia, hay mucho en juego”. Hay mucho en juego porque la gente confía en la IA, pero la IA no tiene responsabilidad.

Este estudio destaca una falla crítica en el despliegue actual de herramientas sanitarias de IA. La falta de una evaluación independiente antes del despliegue generalizado corre el riesgo de diagnósticos erróneos, retrasos en el tratamiento y consecuencias potencialmente mortales.

Conclusión

El hecho de que ChatGPT no pueda identificar de manera confiable las emergencias médicas subraya la necesidad urgente de realizar pruebas y supervisión estrictas antes de confiar decisiones de salud críticas a la IA. Hasta que estos sistemas puedan demostrar una precisión constante en la clasificación, los usuarios deben ser cautelosos y priorizar la experiencia médica verificada sobre el asesoramiento automatizado.