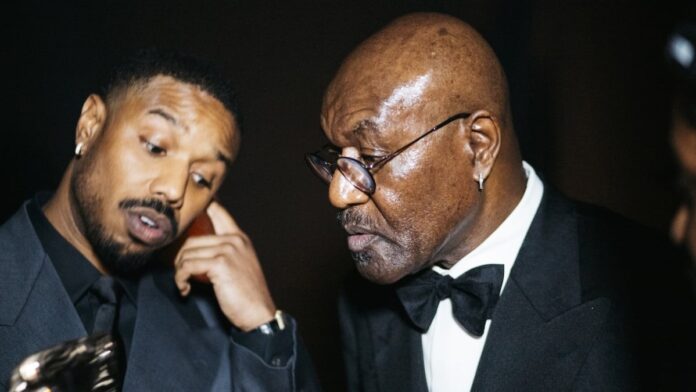

El incidente se produjo durante la retransmisión de los Premios de Cine de la Academia Británica de Cine (BAFTA) el domingo, donde un hombre con síndrome de Tourette gritó involuntariamente un insulto racial mientras los presentadores Michael B. Jordan y Delroy Lindo estaban en el escenario. El insulto fue audible durante la cobertura televisiva de la BBC y permaneció en el servicio de transmisión de la BBC hasta el lunes.

Después del evento, Google envió notificaciones automáticas a algunos usuarios con enlaces a un artículo de Hollywood Reporter sobre los premios. Estas notificaciones contenían el insulto ofensivo completo, lo que provocó una rápida disculpa por parte de los funcionarios de Google. La compañía atribuyó el error no a la inteligencia artificial (IA), sino a que sus propios filtros de seguridad no reconocieron un eufemismo para el insulto que aparece en las páginas web y posteriormente aplicaron el término ofensivo real al texto de la notificación.

El contexto más amplio de este incidente incluye un escrutinio cada vez mayor sobre cómo las emisoras y las plataformas tecnológicas manejan los momentos sin filtrar y el contenido potencialmente ofensivo. Si bien los funcionarios de los BAFTA informaron a los asistentes que una persona con síndrome de Tourette estaba presente, la disculpa del presentador Alan Cumming fue recibida con críticas.

Las consecuencias se extienden más allá de la transmisión inmediata, ya que algunos espectadores también notaron la decisión de la BBC de cortar partes del discurso de aceptación del director Akinola Davies Jr., que incluía una declaración sobre “Palestina libre”. La BBC no ha explicado públicamente esta elección editorial.

El hombre con síndrome de Tourette, más tarde identificado como Davidson, emitió un comunicado expresando mortificación si sus tics involuntarios se interpretaban como intencionales o significativos. BAFTA ha anunciado una revisión exhaustiva del evento.

El incidente plantea dudas sobre el equilibrio entre la transmisión en vivo, el control editorial y la responsabilidad de moderar el contenido potencialmente dañino, especialmente a medida que los sistemas de moderación impulsados por IA continúan evolucionando.