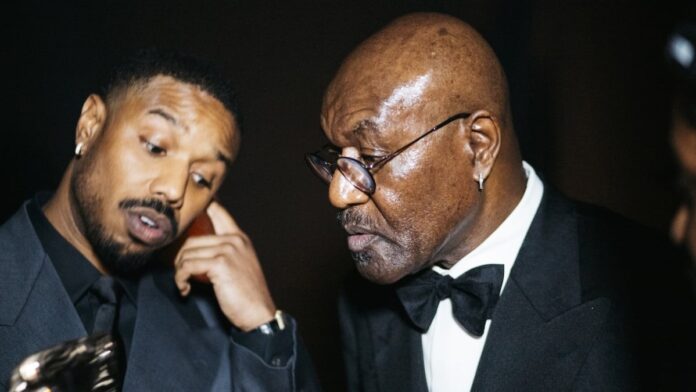

L’incident découle de la diffusion des British Academy Film Awards (BAFTA) dimanche, au cours de laquelle un homme atteint du syndrome de Tourette a involontairement crié une insulte raciste alors que les présentateurs Michael B. Jordan et Delroy Lindo étaient sur scène. L’insulte était audible pendant la couverture télévisée de la BBC et est restée sur le service de streaming de la BBC jusqu’à lundi.

Après l’événement, Google a envoyé des notifications push à certains utilisateurs renvoyant vers un article du Hollywood Reporter sur les récompenses. Ces notifications contenaient des insultes complètes et offensantes, ce qui a suscité de rapides excuses de la part des responsables de Google. L’entreprise a attribué l’erreur non pas à l’intelligence artificielle (IA), mais à ses propres filtres de sécurité qui n’ont pas reconnu un euphémisme pour l’insulte apparaissant sur les pages Web et ont ensuite appliqué le terme offensant au texte de notification.

Le contexte plus large de cet incident inclut une surveillance croissante de la manière dont les diffuseurs et les plateformes technologiques gèrent les moments non filtrés et les contenus potentiellement offensants. Alors que les responsables de la BAFTA ont informé les participants qu’une personne atteinte du syndrome de Tourette était présente, les excuses de l’animateur Alan Cumming ont été critiquées.

Les retombées s’étendent au-delà de la diffusion immédiate, puisque certains téléspectateurs ont également noté la décision de la BBC de supprimer des parties du discours d’acceptation du réalisateur Akinola Davies Jr., qui comprenait une déclaration sur la « Palestine libre ». La BBC n’a pas expliqué publiquement ce choix éditorial.

L’homme atteint du syndrome de Tourette, identifié plus tard comme étant Davidson, a publié une déclaration exprimant sa mortification si ses tics involontaires étaient interprétés comme intentionnels ou significatifs. BAFTA a annoncé une révision complète de l’événement.

L’incident soulève des questions sur l’équilibre entre la diffusion en direct, le contrôle éditorial et la responsabilité de modérer les contenus potentiellement dangereux, d’autant plus que les systèmes de modération basés sur l’IA continuent d’évoluer.