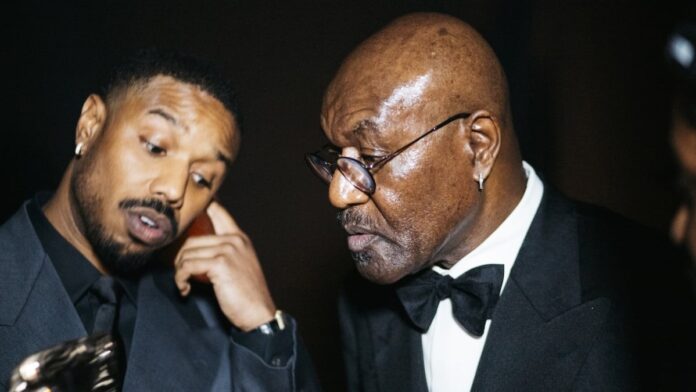

L’incidente è avvenuto durante la trasmissione dei British Academy Film Awards (BAFTA) di domenica, dove un uomo con la sindrome di Tourette ha involontariamente urlato un insulto razzista mentre i presentatori Michael B. Jordan e Delroy Lindo erano sul palco. L’insulto è stato udibile durante la copertura televisiva della BBC ed è rimasto sul servizio di streaming della BBC fino a lunedì.

In seguito all’evento, Google ha inviato notifiche push ad alcuni utenti collegandosi a un articolo di Hollywood Reporter sui premi. Queste notifiche contenevano insulti offensivi completi, che hanno suscitato le immediate scuse dei funzionari di Google. L’azienda ha attribuito l’errore non all’intelligenza artificiale (AI), ma ai propri filtri di sicurezza che non hanno riconosciuto un eufemismo per l’insulto apparso sulle pagine web e hanno quindi applicato il termine offensivo vero e proprio al testo della notifica.

Il contesto più ampio di questo incidente include un crescente controllo su come le emittenti e le piattaforme tecnologiche gestiscono momenti non filtrati e contenuti potenzialmente offensivi. Mentre i funzionari del BAFTA informavano i partecipanti che era presente una persona con la sindrome di Tourette, le scuse del conduttore Alan Cumming sono state accolte con critiche.

Le conseguenze si estendono oltre la trasmissione immediata, poiché alcuni telespettatori hanno anche notato la decisione della BBC di tagliare parti del discorso di accettazione del regista Akinola Davies Jr., che includeva una dichiarazione sulla “Palestina libera”. La BBC non ha spiegato pubblicamente questa scelta editoriale.

L’uomo con la sindrome di Tourette, successivamente identificato come Davidson, ha rilasciato una dichiarazione in cui esprimeva mortificazione se i suoi tic involontari fossero stati interpretati come intenzionali o significativi. I BAFTA hanno annunciato una revisione completa dell’evento.

L’incidente solleva interrogativi sull’equilibrio tra trasmissione in diretta, controllo editoriale e responsabilità di moderare contenuti potenzialmente dannosi, soprattutto perché i sistemi di moderazione basati sull’intelligenza artificiale continuano ad evolversi.