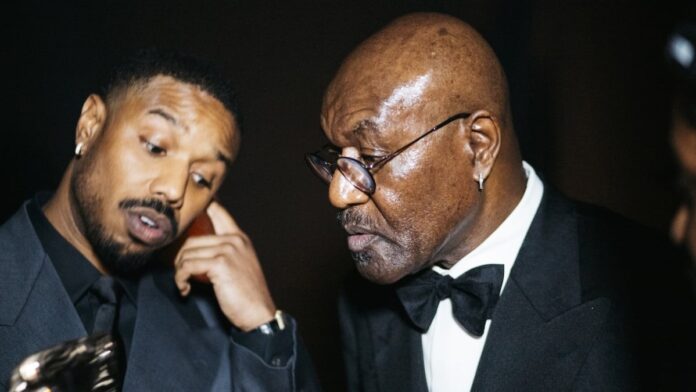

O incidente resultou da transmissão do British Academy Film Awards (BAFTAs) no domingo, onde um homem com síndrome de Tourette gritou involuntariamente uma injúria racial enquanto os apresentadores Michael B. Jordan e Delroy Lindo estavam no palco. A calúnia foi audível durante a cobertura televisiva da BBC e permaneceu no serviço de streaming da BBC até segunda-feira.

Após o evento, o Google emitiu notificações push para alguns usuários com links para um artigo do Hollywood Reporter sobre os prêmios. Essas notificações continham calúnias ofensivas e completas, o que gerou um rápido pedido de desculpas dos funcionários do Google. A empresa atribuiu o erro não à inteligência artificial (IA), mas aos seus próprios filtros de segurança que não reconheceram um eufemismo para a calúnia que aparece nas páginas da web e, posteriormente, aplicaram o próprio termo ofensivo ao texto da notificação.

O contexto mais amplo deste incidente inclui um escrutínio crescente sobre como as emissoras e plataformas tecnológicas lidam com momentos não filtrados e conteúdo potencialmente ofensivo. Embora os funcionários do BAFTA informassem aos participantes que uma pessoa com síndrome de Tourette estava presente, o pedido de desculpas do apresentador Alan Cumming foi recebido com críticas.

As consequências vão além da transmissão imediata, já que alguns telespectadores também notaram a decisão da BBC de cortar partes do discurso de aceitação do diretor Akinola Davies Jr., que incluía uma declaração sobre “Palestina Livre”. A BBC não explicou publicamente esta escolha editorial.

O homem com síndrome de Tourette, mais tarde identificado como Davidson, divulgou um comunicado expressando mortificação caso seus tiques involuntários fossem interpretados como intencionais ou significativos. O BAFTA anunciou uma revisão abrangente do evento.

O incidente levanta questões sobre o equilíbrio entre a transmissão ao vivo, o controle editorial e a responsabilidade de moderar conteúdo potencialmente prejudicial – especialmente à medida que os sistemas de moderação baseados em IA continuam a evoluir.